A cég azzal érvel, hogy a „supply chain risk” minősítés azonnali és jelentős bevételkiesést okozhat, ha elveszíti a jelenlegi és jövőbeni szövetségi szerződéseit. A kereset szerint több kormányzati beszállító máris aggályokat fogalmazott meg, felfüggesztette az együttműködést, vagy a szerződések megszüntetését fontolgatja a kockázati besorolás miatt.

A keresetben alperesként szerepel a védelmi minisztérium, az azt vezető Hegseth, valamint több más kormányzati intézmény és kabinettag is. A Pentagon az amerikai Forbes megkeresésére annyit közölt, hogy folyamatban lévő jogi ügyekről nem nyilatkozik. Az Anthropic szóvivője, Danielle Cohen ugyanakkor azt mondta: a per „szükséges lépés”, miközben a vállalat a konfliktus rendezésének minden lehetséges útját nyitva tartja.

A kereset hangsúlyozza, hogy a kormány a vállalat alapelveihez való ragaszkodás miatt próbálja megbüntetni az Anthropicot.

A céget egykori OpenAI-alkalmazottak alapították, akik a mesterséges intelligencia biztonságával kapcsolatos nézeteltérések miatt hagyták el korábbi munkahelyüket. A dokumentum szerint az Anthropic számára „éles választási helyzetet” teremtettek: hallgasson az AI-biztonságról alkotott álláspontjáról, és kínálja a Claude rendszert a kormány által elvárt feltételekkel – vagy számoljon súlyos következményekkel.

Korábban egyetlen amerikai céget sem büntettek így

A konfliktus hátterében egy 2025 júliusában kötött, mintegy 200 millió dollár értékű szerződés áll a Pentagon és az Anthropic között. A viszony azonban az év elején romlani kezdett, miután a vállalat nem volt hajlandó feloldani bizonyos biztonsági korlátozásokat AI-modelljei használatában. Az Anthropic ragaszkodott ahhoz, hogy technológiáját ne lehessen tömeges belföldi megfigyelésre vagy teljesen autonóm fegyverrendszerek működtetésére használni.

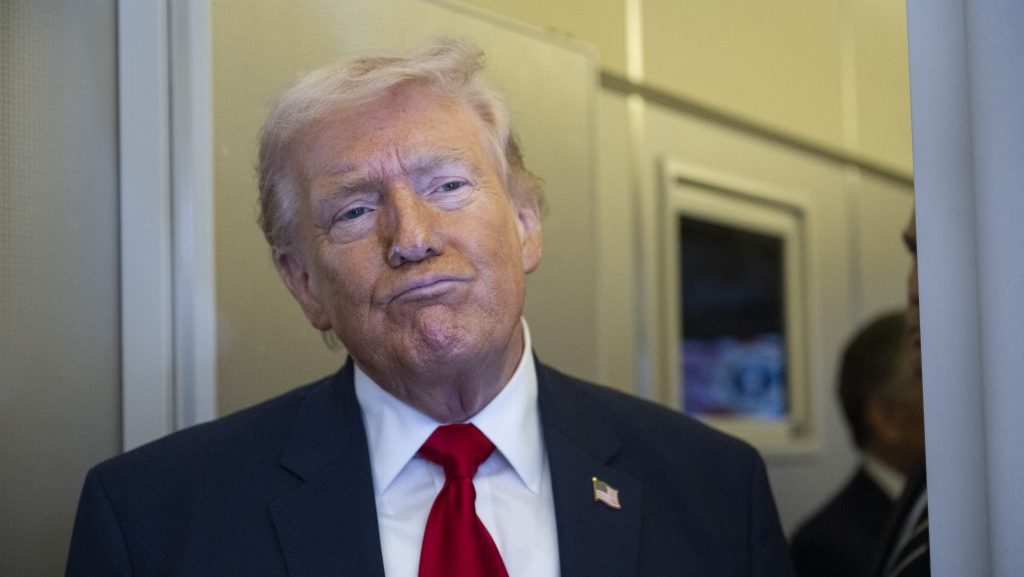

Pentagon-tisztviselők vitatják, hogy a hadsereg ilyen célokra kívánta volna használni a technológiát. Hegseth február 27-én jelentette be, hogy az Anthropicot „ellátási lánc kockázatként” fogják kezelni, a döntés a múlt héten lépett hivatalosan hatályba.

Az amerikai jog szerint „supply chain risk” minősítést olyan rendszerek kaphatnak, amelyek esetében fennáll a veszélye annak, hogy ellenséges szereplők szabotázst hajtanak végre, rosszindulatú funkciókat építenek be, vagy más módon manipulálják az adott technológiát. Az ilyen besorolás gyakorlatilag megtiltja a kormányzati szerveknek és beszállítóknak, hogy az adott technológiát – jelen esetben az Anthropic Claude chatbotját – állami projektekben használják.

Az Anthropic szerint ez a döntés példátlan: állításuk szerint korábban egyetlen amerikai vállalatot sem minősítettek ilyen kockázatnak. A cég hangsúlyozza, hogy korábban a kormányzat rendszeresen megadta azokat a biztonsági engedélyeket, amelyek lehetővé tették az Anthropic alkalmazottainak a titkos projektekben való munkát.

A vállalat azt is állítja, hogy semmilyen kapcsolatban nem áll az Egyesült Államok által ellenségesnek minősített országokkal – köztük Kínával, Oroszországgal, Iránnal, Észak-Koreával, Kubával vagy Venezuelával –, és jelentős erőfeszítéseket tett annak érdekében, hogy technológiáját ne használhassák fel például kínai állami kiberműveletekben.

A per jelentősége bőven túlmutat azon, hogy az Anthropicról végül lekerül-e az ellehetetlenítését célzó bélyeg. Tágabb kontextusban az ügy kimenetele alapvetően határozhatja meg, hogy a politikai milyen mértékben telepedhet rá a magánszektorra és mekkora lehet a jövőben a zsarolási potenciálja.